Un Anaximandro del Siglo XXI

Gustavo Romero es uno de los físicos más importantes del país. Profesor Titular de la Facultad de Ciencias Astronómicas y Geofísicas de la Universidad Nacional de la Plata e Investigador Científico del CONICET en el Instituto Argentino de Radioastronomía. Si bien su especialidad es la astrofísica también se distingue por sus aportes académicos en el campo de la filosofía científica. Física y filosofía, una vieja síntesis helénica. Desde Anaximandro de Mileto y su ápeiron cosmogónico hasta las discusiones entre Eisntein y Bohr por la mecánica cuántica, la física y la filosofía tuvieron mucho en común pero ¿cuál es el estado actual de esa pareja? En este reportaje, Romero abunda en la relación entre la Física y la Filosofía a la vez que, en clave de divulgación científica, toca conceptos físicos fundamentales. La teoría de cuerdas, Stephen Hawking, el problema ciencia-religión y los científicos-divulgadores son también algunos temas en los que Romero profundiza sin rodeos ni concesiones.

¿Cómo fue tu primer vínculo con la filosofía desde la física?

Como profesor de astrofísica relativista en la FCAyG-UNLP, veo frecuentemente que muchos estudiantes empiezan carreras como física o astronomía motivados por la curiosidad y por la necesidad de tratar de entender, lo mejor posible, el mundo que los rodea. En mi caso particular como estudiante, el interés original fue filosófico. Las preguntas básicas que yo me planteaba eran filosóficas; del tipo: ¿porqué el universo es como es y no de otra manera?, ¿qué son las leyes de la física? o ¿porqué existen las cosas? Entonces, originalmente elegí estudiar astronomía pensando que ella podía llegar a aportarme algunas respuestas a esas preguntas. A poco de cursar astronomía, el planteo de la carrera me decepcionó un poco. Astronomía era una carrera de orientación claramente observacional que no le daba demasiada importancia al trasfondo de las teorías en las que se basaba. Cursé un año y al siguiente me tocó el servicio military, dos años en la infantería de marina, luego del cual sólo me quedó empezar de nuevo otra carrera y opté por física porque me pareció que era lo que necesitaba para entender mejor, para poder ir más al fondo de las cuestiones básicas desde un punto de vista científico. Siempre tuve la sensación de que para responder esas preguntas filosóficas, que a mi tanto me motivaban, primero tenía que saber ciencia. La especulación del diletantismo nunca me atrajo, siempre pensé que era necesario encontrar respuestas usando, por un lado, la razón y, por otro, la experiencia, basándose en la mejor imagen que uno dispone del mundo para poder intentar alguna aproximación a esos temas, macrotemas y megatemas.

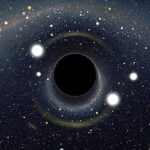

Muchos alumnos que hoy tienen esas mismas inquietudes que yo tuve a su edad, cuando se están por licenciar, tratan de buscar áreas como la cosmología, los fundamentos de la mecánica cuántica o cosas muy básicas relacionadas al espacio y el tiempo tales como los agujeros negros. Ese tipo de temas, formalmente tan complejos, atrae mucho a los estudiantes de física y cabe preguntarse porqué. Yo creo que la respuesta es porque tocan cuestiones realmente fundamentales sobre la estructura de la naturaleza y la organización de la realidad. Hay una necesidad psicológica en el ser humano por de tratar de entender qué es lo que pasa en su entorno.

Yo, particularmente, si bien no tengo un título académico en filosofía publico y refereo regularmente en revistas internacionales de filosofía, participo en congresos…podría decirse que he desarrollado una actividad académica paralela que me enriquece, y creo enriquece la ciencia que hago y la que enseño.

Mario Bunge opina que es mucho más fácil encontrar físicos que puedan tener aportes significativos en filosofía que al revés.

Si, al revés es muy difícil porque, en general, los filósofos que se dedican a la filosofía de la ciencia, que estudian fundamentos o teorías científicas, tocan de oído cuando se refieren a esas teorías. Lo que hacen es leer algún libro de divulgación. Las revistas de filosofía están llenas de artículos donde se discute sobre el espacio y el tiempo y que se basan en libros de divulgación, a veces, muy malos. Comenten errores muy graves y uno de los problemas que tiene el sistema académico en filosofía es que los árbitro solo son otros filósofos que no tienen conocimientos más precisos sobre las teorías que los filósofos están discutiendo. Debería existir un sistema de arbitraje interdiciplinario y con controles múltiples. Sino, la basura prolifera de una manera descontrolada en ciertos círculos académicos. Puede llegar a ser verdaderamente asombroso.

Entonces hay enormes discusiones sobre cuestiones que, con un poco de conocimiento serio de física, se podrían abordar con mayor rigor académico. Por eso yo creo que para la persona que quiera hacer filosofía a nivel académico competitivo, publicando e investigando, el mejor camino es primero tener una formación en ciencia. Las herramientas formales, como lógica y semántica, que hacen falta para investigar en filosofía se pueden adquirir fácilmente después.

¿Es una tendencia generalizada entre los filósofos la de nutrirse con literatura de divulgación como fuente bibliográfica de sus investigaciones?

No todos caen en eso, pero hay muchos que si. Por ejemplo, yo soy referí de varias revistas de filosofía, una de ellas es International Journal for Philosophy of Religion. En esa revista aparecen muchas autores con supuestos argumentos o nuevas versiones de argumentos cosmológicos para demostrar la existencia de Dios basadas en lecturas de los libros de Stephen Hawking… O sea, sin entender en profundidad utilizan jerga hawkingniana tal como “tiempo imaginario” pero cuando los evalúa un respecialista que entiende de física no queda otra que el rebote de la publicación. Normalmente, esos filósofos no tienen la más remota idea de lo que están diciendo pero suponen naturalmente, por un lado, el si-Hawking-lo-dijo-debe-cierto y, por otro, que el argumento de autoridad será suficiente para validar un artículo que, en los hechos, no aportará nada. Hay una proliferación de literatura basura muy peligrosa para los estudiantes que todavía no tienen el criterio para diferenciar lo que es serio y lo que está bien fundamentado de lo que no lo está.

El reconocido físico Carlo Rovelli adjudica el presunto estancamiento de la física teórica actual a la falta de formación de sus colegas en filosofía clásica, tal como la tuvieron los grandes físicos europeos de principios del Siglo XX, ¿t u opinión?

Coincido con el diagnóstico de Carlo Rovelli. Hay un problema serio, hay una crisis, en la física teórica. La física teórica no está creciendo como otras ramas de la física y como otras ramas de la ciencia. Las neurociencias han crecido en forma extraordinaria en los últimos veinte años. La física teórica posterior al modelo estándar de las partículas elementales está estancada. Eso pasó a mediados de los años setenta. Luego, hace más de treinta o casi cuarenta años que la física teórica está empantanada. El resultado es que una gran cantidad de físicos teóricos, formados en partículas, se empiecen a ir a otros campos como la astrofísica, la teoría de campos aplicada a materia condensada o la cosmología donde pueden aplicar sus conocimientos. Los últimos premios Nobeles en física han recaído, en general, en la gente que ha hecho fuertes contribuciones en el campo de la astronomía, la astrofísica y la cosmología. Algunos también han migrado hacia la física del estado sólido y de la materia condensada, donde también pueden aplicar un poco la formación que adquirieron como físicos teóricos. Pero la física teórica básica no ha realizado progresos. Y eso tiene causas múltiples. Una, con la que acuerdo con Rovelli, es que la forma de hacer física cambió con la segunda guerra mundial: hay un antes y un después. Antes de la segunda guerra mundial y quizás antes de la llegada del nazismo al poder, el centro mundial del la física estaba en Alemania. Los grandes físicos eran alemanes: Boltzmann, Ehrenfest, Einstein, Planck , Heisenberg, Jordan, Born y otros. También matemáticos: Felix Klein, David Hilbert, Hermann Minkowski y otros. Göetingen y Berlín eran los centros del pensamiento científico mundial. Incluso el idioma alemán era un idioma usual de comunicación entre los científicos. Todos los grandes trabajos publicados por Einstein, por ejemplo, están publicados en idioma alemán. Y la forma que tenía esa gente de trabajar era muy diferente de la forma que se tiene hoy. Personas con una formación completa que también tenían intereses muy amplios. Einstein era un tipo que tenía profundas motivaciones filosóficas y profundas motivaciones estéticas a la hora de encarar sus trabajos. Por ejemplo lo que lo lleva a la relatividad especial no son los resultados del experimento de Michelson y Morley sino su admiración por las teorías de campo y su convicción de que si hay que cambiar algo para que resulte invariante no hay que cambiar la teoría de Maxwell, que es una teoría de campo, sino que hay que cambiar la mecánica. Básicamente, en términos matemáticos, la teoría de la relatividad estaba formulada antes de Einstein; o sea, las ecuaciones de Lorentz ya existían y Poincaré ya había señalado los principales puntos de la relatividad especial, pero nadie se había animado a decir: “bueno, vamos a considerar que las transformaciones que deben obedecer las leyes de la física, las cuales deben ser invariantes, son la transformaciones de Lorentz y, entonces vamos a dejar tal como está a la electrodinámica pero vamos a cambiar la mecánica que, tal como está formulada, no es invariante por las transformaciones de Lorentz sino por las transformaciones de Galileo”. Ese paso es el que hace de la teoría de la relatividad lo que es hoy en día y Einstein lo da por consideraciones prácticamente metafísicas. La convicción de que la estructura de la realidad tiene que ser tal que los campos juegan un papel fundamental. El concepto de campo para Einstein siempre fue importante porque la teoría de Newton de la gravedad, que no es una teoría de campo sino una teoría de acción a distancia, no lo satisfacía. Einstein quería que la gravedad estuviese mediada por un campo y que la formulación de las leyes de la gravedad fuese invariante frente a transformaciones de coordenadas. O sea, la Relatividad General. Pero, de nuevo, ahí, una vez más, hay motivaciones filosóficas. Sin eso, la gravedad es magia, y Newton lo sabía y lo acepto. Einstein no. Bueno, esos reflejos son los que hoy se han perdido. Después de la segunda guerra mundial y, en particular, tras el éxito del proyecto Manhattan, que involucró a muchos físicos, surge una forma de hacer ciencia basada en el pragmatismo norteamericano en la cual lo que importa es el resultado concreto. Lo que importa es el detalle y el trabajo en equipos para lograr objetivos bien concretos, lo cual resta importancia al trasfondo filosófico de las cuestiones científicas. Y eso, en mi opinión, ha generado un montón de problemas tales como que los formalismos de las teorías se han empezado a separar de las interpretaciones. Los formalismos están muy bien trabajados, muy bien pulidos, pero no están claras las interpretaciones. Entonces usamos teorías con las cuales podemos calcular y predecir cosas con mucha precisión pero no sabemos bien de qué hablan.

En mecánica cuántica, por ejemplo en la teoría cuántica de campos, muchos físicos no reconocen claramente cuáles son los mismísimos referentes de esas teorías. A un físico exitoso promedio, que hoy publique mucho en revistas prestigiosas, le haces algunas preguntas muy básicas sobre los referentes de la mecánica cuántica o sobre qué significa el llamado colapso de la función de onda o tocás ciertos temas de teoría cuántica de la gravedad y vas a ver que, pese a ser virtuoso en el manejo de los formalismos, nunca se planteó alguna de esas cuestiones y probablemente ni siquiera se percató de que existen. Por otro lado aparecen, en este desprecio de las interpretaciones semánticas de las teorías y de los fundamentos filosóficos de las teorías, un montón de pseudo problemas.

¿Por ejemplo?

Uno de ellos es el de la supuesta destrucción de la información en los agujeros negros. La información es un concepto semántico, no es una propiedad física de los sistemas; éstos pueden tener temperatura o entropía pero no tienen información. La información no es una propiedad de los sistemas físicos, la información es una propiedad de la transmisión de los lenguajes. En el fondo, la información es una ficción, no es una cantidad física. Y la gente, hablando en forma vaga, se confunde al mencionar leyes de conservación de la información. Luego, cuando se aplica el mismo formalismo que, por ejemplo, se utiliza para describir la entropía para describir la información se está igualando los conceptos entropía e información, lo cual es incorrecto. Que vos uses las mismas herramientas formales para representar distintos aspectos de la realidad no quiere decir que esos aspectos sean idénticos. Para mi el problema está mal formulado de entrada. La información no se puede perder o no perder en un agujero negro, a menos de tener una señal codificada por un lenguaje. Para que haya una señal que contenga información tiene que haber alguien que codifique la señal y alguien que la decodifique, la interprete y forme una proposición. La información en el fondo es el contenido proposicional que tiene una señal. En los procesos naturales no hay contenido proposicional alguno, porque las proposiciones son conceptos y los conceptos sólo pueden ser fabricados por el cerebro. Entonces, de lo que en el fondo se está hablando es de un problema que está relacionado con la mecánica cuántica, que es el problema de la pérdida de coherencia partículas que son generadas cerca del horizonte de eventos. Uno puede tener partículas que tienen ciertas correlaciones, entonces si una partícula se pierde en el agujero negro y la otra sale al universo externo, en principio las dos partículas, tendrían que seguir correlacionadas, tendrían que seguir ambas en un estado puro. Ahora, cuando el agujero negro supuestamente se evapora lo que te devuelve no es un estado puro, lo que te devuelve es un fotón térmico, porque se está evaporando, que tiene una temperatura; el espacio circundante al agujero negro emite radiación térmica y la partícula térmica no está en estado puro, está en una superposición de estados. Luego, ahí hay un problema para la mecánica cuántica que es explicar cómo se pasó de un estado puro a un estado térmico. Hay distintas formas de resolver ese problema que no tienen nada que ver con la información. Pero bueno, hay muchas confusiones que se originan en ese desprecio de la interpretación, de la semántica de la teoría, de de los fundamentos propios de la ciencia.

Entonces, los sistemas de gestión y administración de la ciencia, ¿pueden influir en las maneras de abordar los problemas?

En el sistema norteamericano no hay tiempo para que el investigador se dedique a los fundamentos: si vos te dedicas a desarrollarlos estás perdiendo el tiempo porque vas a publicar menos artículos que van a servir para ganar subsidios que es lo que, en el fondo, hace valioso al investigador. ¿Por qué?, porque la universidad norteamericana elige a los profesores que va a contratar de acuerdo a la capacidad que éstos tienen de conseguir subsidios dado que a ella le quedan los diezmos u overheads, lo cual le significa una importante fuente de ingresos propios. Entonces, lo que hace la universidad es priorizar a aquellos investigadores que publican mucho y que pueden conseguir, por lo tanto, subsidios jugosos. La academia se ha monetarizado, se ha comercializado en detrimento de la búsqueda de la solución a los grandes problemas. La gente ya no se plantea grandes problemas, porque los grandes problemas requieren mucho tiempo y una maduración que te quita ritmos altos de publicación. En el ambiente norteamericano es común encontrar algunas personas que publican veinte o treinta trabajos por año, o sea, un trabajo cada quince días, entonces vos pensá qué grado de maduración puede tener un trabajo si lo haces en quince días. Lo más probable es que domines un método de cálculo y que lo apliques una y otra vez a distintos problemas, pero sin plantearte muy bien qué es lo que está pasando en los trasfondos. No digo que todos hagan esto, pero digo que hay una presión del sistema para que la gente se comporte de esa manera. Y eso ha llevado a que la originalidad desaparezca, porque siempre es más confiable adoptar una técnica comprobada y volver a aplicarla que lanzar o tratar de plantear de cero un nuevo problema. El mercado presiona para que se asignen puestos académicos a los científicos que tienen capacidad de obtener grandes subsidios y, por lo tanto, a estar en el futuro en posición para elegir a nuevas personas que se incorporan al sistema, personas cuyos trabajos puedan resonar con los de sus contratantes. Entonces hay una especie de reproducción de los temas en el sentido de que los discípulos se forman a imagen y semejanza de los maestros y, después, los maestros deciden que ellos sean los que los reemplacen en las cátedras. El sistema académico “monotematiza”. Yo creo que eso pasó en buena medida con el boom de publicaciones de la teoría de cuerdas a fines de los noventa en Estados Unidos. Sin embargo hoy es una teoría que, finalmente, llegó a una especie de callejón sin salida, una teoría que no puede en principio hacer predicciones, por razones técnicas, que tiene una degeneración intrínseca que es prácticamente infinita, y entonces, de repente, tenemos a un montón de físicos ocupando un montón de cátedras muy importantes en las mejores universidades y cuya especialización es algo que no sirve básicamente para nada y que no hay esperanza de que en algún momento sirva. Entonces eso lleva a la crisis actual de la física, porque esa gente no tiene la formación como para dedicarse a hacer otra cosa.

Hace poco salió un artículo en Nature de George Ellis y de Joe Silk, los dos cosmólogos más importantes de la actualidad, mostrando su preocupación por la presión que la comunidad de física teórica vanguardista está haciendo para que cambien las pautas de evaluación de los trabajos científicos. Sostienen que los trabajos científicos no se deben evaluar por el hecho de que predigan o no cosas contrastables sino por su belleza interna y por el consenso en la comunidad; o sea, definitivamente han tomado lo que en filosofía se llama una posición posmodernista: la ciencia es un discurso y una teoría es válida si es aceptada por la comunidad que genera ese discurso. Esa gente está cuidando su trabajo. Si lo que están produciendo no satisface los estándares de lo que, hasta hace poco, se llamaba ciencia entonces hacen una gran presión por que se cambien los estándares de evaluación en lugar de cambiarse ellos hacia otro tema que pueda permitir una salida a este callejón en el cual se encuentran. Y es una situación muy grave porque si esas tendencias llegan a predominar puede significar realmente una crisis muy grande para todo el sistema científico y, sobre todo, en una época en la cual otras áreas de la ciencia están creciendo mucho y con grandes aportes. Los avances, como te decía, en neurociencias son asombrosos, lo que se sabe hoy del cerebro es realmente asombroso. En los últimos veinte años toda la experimentación sobre el cerebro ha revolucionado el conocimiento que tenemos acerca de cómo funcionan las capacidades cognitivas del ser humano. Entonces, imaginate si, de repente, en otras áreas de la ciencia, también se aplicaran ese tipo de doctrinas: vas a tener publicaciones de diversas cuestiones carentes de controles. Eso puede llevar a serios problemas. Entonces, yo creo que estamos en una etapa de crisis donde todavía la física teórica no ha tocado fondo pero no parece haber reacción para no tocarlo.

Coincidiendo con Rovelli, la situación es difícil por múltiples causas. La causa sociológica reside en la organización empresaria de estilo norteamericano del sistema científico. Esa organización funcionó para fabricar una bomba atómica o para crear los aceleradores de partículas que llevaron a la gran explosión de la física de partículas a fines de los cincuenta, pero no sirvió para encontrar nueva física. Desde que terminó la segunda guerra mundial no hay nueva física. Sólo hay teorías como la de cuerdas con una degeneración de 10500. ¿Qué significa eso?, que ellos trabajan con modelos de branas en muchas dimensiones, más de las que existen en el mundo real, porque esas branas cuando oscilan tienen modos de oscilación que dan lugar a las propiedades supuestas de las partículas. Ahora, cuando vos elevas el número de dimensiones a once, que es lo que ellos usan para poder dar cuenta de todas las partículas elementales, esas dimensiones extra no son observables porque, supuestamente, están compactificadas… Pero ¿qué pasa?, hay una enorme cantidad de espacios topológicos de once dimensiones que son compatibles con todas las características de la teoría, ¿cuántos? 10500, entonces cada uno de esas topologías da lugar a una versión diferente de la teoría de cuerdas. Por eso la teoría tiene una degeneración de la 10500. O sea, en la práctica, hay infinitas teorías todas posibles pero sin la chances de decidir cuál es la verdadera. Y entonces, ¿qué es lo que hacen?, en vez de decir “bueno, esto es un callejón sin salida, nunca voy a poder predecir nada”, lo que dicen es: “para cada una de estas representaciones topológicas de la teoría de cuerdas hay un universo donde se cumple”, entonces eso lleva a postular infinitos universos. En lugar de tratar de estudiar nuestro universo observable lo que hacen es, como su teoría no puede predecir nada para nuestro universo, postular infinitos universos. Es el paroxismo de la inflación ontológica, anti Ockham total. Un camino metodológico que es opuesto a lo que, tradicionalmente, ha llevado a los grandes descubrimientos de la ciencia. Cuando tu teoría no es compatible con la realidad vos la cambiás, no modificas la realidad agregando infinitos universos. Eso muestra el modus operandi de esta gente, digamos, la metodología que están tratando de imponer. De todas maneras y yo creo que, a la larga, no se va a imponer porque si eso se propagase a todas las áreas de la física y a las demás ciencias dejaría de haber descubrimientos y, en el fondo, habría un conflicto también económico. Entonces ese, yo creo, que es el límite último que este gente tiene. Pero mientras se mantengan en el ámbito puramente académico, este tipo de cosas van a pasar, a menos que se reestructure el sistema científico y, en particular el de la física teórica. Los astrónomos, astrofísicos, los cosmólogos están muy preocupados por la invasión de sus campos de trabajo y la devaluación de sus estándares de evaluación. Justo en un momento donde, por ejemplo, la cosmología, que usualmente era considerada una ciencia muy especulativa, ahora está entrando en una etapa de alta precisión a partir de las medidas increíblemente detalladas que hay del fondo cósmico de radiación y de otras mediciones. Entonces, los cosmólogos están aterrorizados de que, en breve, proliferen los universos y la disciplina vuelva a la vieja especulación sin asidero con la realidad. Por eso Ellis y Silk publicaron ese artículo valiente para llamar la atención y proponer una reunión, en la cual también participen filósofos, para tratar de mostrar que hacen falta estándares estrictos a la hora de evaluar. El problema es que hay muchos filósofos que no están de acuerdo con eso porque la filosofía ha sufrido un proceso similar en el mundo anglosajón después de los grandes desarrollos en lógica de la década del treinta y del cuarenta en los que se establece la semántica formal. A partir de los años cincuenta, los lógicos se dedicaron, más que nada, a fabricar lógicas alternativas. La mayor parte de las aplicaciones de la lógica están en la lógica del primer orden, que es lo que se llama la lógica de predicados, y algunas cosas de la lógica del segundo orden. Después hay muchas otras lógicas, infinitas lógicas posibles, pero que no tienen la aplicación a la realidad en su mayoría. Una de esas lógicas, es la que se llama lógica modal, la lógica de la posibilidad, que siempre se ha considerado como un mero juego formal que no tiene aplicación en la realidad (Bunge ha sido muy crítico de ella). Un filósofo llamado Saul Kripke postuló que esa lógica modal, la lógica de la posibilidad, podía resolver su problema fundamental que es cómo establecer el valor de los enunciados, el valor de verdad de los enunciados, postulando infinitos mundos también. Entonces un enunciado es posible si hay un mundo en el cual ese enunciado es verdadero. Un montón de lógicos modales se dedicaron a reformular la lógica modal en términos de la pluralidad de los mundos o también de infinitos universos. Así todo cierra con la postura de los cuerdistas y sus infinitos universos que, además, no interaccionan entre sí y están totalmente desconectados. Jamás podrás, siquiera en principio, tener un experimento que te permita establecer la realidad de esos otros universos pero, ¿qué pasa? tanto esos lógicos, que están sin problemas serios de los que ocuparse, como los físicos teóricos, de repente se encuentran que tienen intereses comunes y comienzan a apoyarse mutuamente. Esto termina en científicos como Hawking que hablan de la muerte de la filosofía, refiriéndose a la filosofía tradicional, y tenés a filósofos que dicen “bueno, hay que basar la filosofía en las modernas teorías de la física” haciendo referencia a la teoría de cuerdas y a la teoría del multiverso… Movimiento peligroso, si los hay: se apartan de la realidad y de los problemas reales y pasan a ser simplemente un discurso, un discurso posmodernista. Un relato.

¿Cómo caracterizarías tu relación entre la filosofía clásica y la física? ¿Las currícula de las carreras de grado en Física debería contemplar formación en filosofía clásica o debe seguir siendo cosa de diletantes?

Yo creo que la filosofía necesita de la ciencia y la ciencia necesita de la filosofía, creo que la filosofía que tiene chances de hacer aportes reales a la sociedad y a la cultura es lo que se llama filosofía científica. Esto es una filosofía que está informada por la ciencia, por la buena ciencia y, que a su vez, le puede proveer a la ciencia el marco mas general en el cual se desarrollen las teorías científicas y ayudar a que esas teorías, a veces, no se desbanden, poniendo criterios estrictos de evaluación, de peso de la evidencia, etc. Creo que hay una relación simbiótica, o debería haber una relación simbiótica entre filosofía científica y ciencia. La filosofía científica se ocupa de problemas bien concretos, problemas como qué es una ley científica, qué es un evento, qué es una cosa, qué es una teoría, qué es un modelo, qué diferencia hay entre teoría y modelo, qué es el espacio, qué es el tiempo, qué es el espaciotiempo, cuales son los constituyentes últimos de las cosas, qué son los infinitos –¿existen en la realidad o son meras construcciones matemáticas?– y mucho más. Fijate que los físicos hablan todo el tiempo de infinito pero vos le preguntas qué es el infinito y no saben decirte. Un físico que esté bien informado de esos tópicos va a hacer mejor física. O un científico, en general, va a hacer mejor ciencia. Por otro lado, un filósofo que no conozca el estado de la ciencia actual cuando hable del espacio y del tiempo va a decir disparates; debería conocer, por ejemplo, relatividad general. O un filósofo que se ocupe del problema del libre albedrío, si no conoce los avances actuales de la neurociencia simplemente va a hacer especulaciones. La relación es simbiótica. ¿Cómo se trata eso, a nivel universitario?, ¿a nivel formativo de los estudiantes? En mi opinión debería haber, básicamente, para todas las carreras de ciencia, una materia de ciencias formales, como lógica y semántica, que complementen la formación matemática para que el futuro graduado sepa utilizar e interpretar los lenguajes formales. Una única materia de filosofía científica, dónde se explique qué es lo que entendemos por una ley, si hay leyes de leyes, si puede haber propiedades de propiedades, qué es un cambio, qué es el azar, qué es una propensión, qué es una probabilidad, o sea, cosas que permanentemente el científico usa pero que jamás se plantea qué son, cómo se definen, qué rol juegan dentro de todo el esquema del conocimiento que él está tratando de abordar. Entonces, una única materia bien enfocada, que tenga una parte de filosofía formal, o sea lógica y semántica y después que tenga algo de ontología, esto es las ideas más generales acerca de lo que hay, básicamente el estudio de cosas, cambios, propiedades, leyes, espacio y tiempo. Finalmente una unidad de epistemología, donde se estudie qué es el conocimiento, qué es aprender, qué es una teoría, qué es una representación de la realidad, qué es un modelo, cuál es la diferencia entre ciencia y pseudociencia –tema muy importante, de gran importancia cultural–, qué es la tecnología, en qué se diferencia la ciencia de la tecnología y, genéricamente, la ética. Yo creo que habría que enseñar ética en una materia de filosofía científica: ética científica, o sea, ética basada en el estudio del comportamiento humano, en tratar de determinar porqué los seres humanos se comportan de una manera o de otra y cuales son las pautas, las normas, esto es la moral, qué conviene para alcanzar ciertos objetivos. Yo creo que uno de los grandes defectos de la formación de los científicos actuales es que deja de lado los aspectos éticos y cada vez más asistimos a casos de plagio, fraude, publicaciones que son refritadas varias veces, conferencias que son robadas y montones de cosas más, y eso se podría ayudar a combatir enseñando un poco la ética. Todos los grandes sistemas de la antigüedad, por ejemplo, del periodo helenístico de Grecia, los sistema de pensamiento epicúreo, estoico y el propio sistema aristotélico siempre empezaban con lo que ellos llamaban una gramática, que es lo que hoy llamaríamos una semántica, el conocimiento del lenguaje que usamos para describir la realidad, después seguían con una física y después con una episteme, para terminar siempre con una ética, al final siempre había una ética. Y eso nosotros lo hemos perdido, ahora la ética no nos importa nada y yo creo que es lo que más tendría que importarnos porque es, en el fondo, lo que codifica cómo nos vamos a comportar y eso tiene incidencia directa en todas nuestras actividades.

En paralelo, ¿vos dirías que los que se forman como filósofos profesionales deberían tener alguna capacitación o, al menos, alguna interacción relativamente rigurosa con el conocimiento científico?

Sin duda. Eso es todo un tema. Las carreras de filosofía en la Argentina tienen gravísimos problemas ya que se orientan principalmente a la lectura de textos y al estudio de autores del pasado. Entonces vos estudiás lo que dijo fulanito, lo que dijo menganito, pero no estudias el problema filosófico en sí. En mi opinión una carrera de filosofía debería estar orientada a plantear problemas abiertos, como se hace en la carrera de física, ¿no? y dar las herramientas para que la gente pueda hacer investigación y resolver esos problemas. O sea, habría que aportar mucho conocimiento de lógica, mucha formación en matemática, habría que dar formación de física y, habría que, claramente, delimitar problemas reales para que la gente trate de resolverlos. Sino lo que vas a tener es que un tipo se va a pasar cinco años de su vida haciendo una tesis sobre la lectura que Walter Benjamin hizo de Heidegger cuando vivió exiliado en París. Una cosa así no le sirve para nada a nadie.

En la carrera de filosofía se podría solucionar con un tronco básico donde se de primero lógica, un poco de matemática, teoría de conjuntos, semántica y un poco de historia de la filosofía, como para que la persona esté orientada en lo que se ha pensado hasta ahora y después algunas materias optativas, de tal manera que la persona que tiene un cierto interés por resolver problemas filosóficos relacionados, por ejemplo, con las ciencias formales pueda cursar en departamentos de matemática. Al que le interesan cuestiones que están relacionadas con la física, el espacio, el tiempo que pueda ir a física y cursar relatividad general, mecánica cuántica. Al que le interesa cuerpo y mente, libre albedrío, cuestiones y problemas relacionados con las neurociencias, bueno, que pueda ir a ámbitos académicos afines. Considero que una carrera así tiene que tener flexibilidad dada por materias optativas que se puedan cursar en otras facultades donde las enseñen docentes que saben e investigan en esas cosas y no personas que te repiten lo que leyeron en los libros de divulgación, con suerte.

¿Hay esquemas curriculares como el que vos proponés en otras partes del mundo?

Si. Los tipos que hacen filosofía competitiva hoy en día (yo mas que nada estoy haciendo filosofía del espacio y del tiempo), son tipos que tienen muy buena formación en relatividad general, son tipos que han tomado cursos de relatividad general, se han formado en matemática, saben análisis tensorial, saben cálculo diferencial, topología… es bastante, y vos discutís con tipos que, si bien son filósofos, tienen una formación que les permite entender todo lo que vos decís como físico. Eso lo he visto en Estados Unidos y en Alemania. Por su parte, en España están muy atrasados en cuestiones de filosofía y en Francia directamente están arruinados por el posmodernismo.

Declaraste en varios foros que hay muchos aspectos extra académicos de Stephen Hawking que son especialmente nocivos para la ciencia, ¿podés ampliar?

Hay varias cosas. Por una lado yo respeto mucho el trabajo académico de Hawking. Su gran aporte lo logra basándose en los teoremas de Roger Penrose. Penrose desarrolló el primer teorema que muestra que el colapso gravitacional de la materia lleva a la formación de un agujero negro y vuelve singular a la teoría general de la relatividad. Hawking generalizó ese teorema, con ayuda del mismo Penrose –el teorema es de Penrose-Hawking–, a todo el universo. Si satisfacían ciertas condiciones, que hoy sabemos que no se satisfacen, entonces la métrica que describía todo el espaciotiempo también era necesariamente singular. Es un teorema que dio lugar a muchos y valiosos trabajos. Hawking hizo, a principios de los años setenta, otras contribuciones muy importantes a la física basándose en ideas previas de Jacob Bekenstein al desarrollar el concepto de la entropía de los agujeros negros y, sobre todo, descubrió lo que hoy se llama radiación de Hawking. La descubrió en forma teórica porque nunca fue comprobada experimentalmente. Es imposible de medir. Primero porque los, agujeros negros más cercanos conocidos están a kiloparsec de distancia. Por ejemplo, Cygnus X-1, que tiene unas catorce masas solares, está a dos kiloparsec de distancia (son unos 6 x 1021 cm). La radiación que emite, por efecto Hawking, es completamente despreciable e indetectable frente a la radiación que se emite por la materia que está dando vuelta alrededor. De hecho los agujeros negros en el universo actual no se están evaporando porque acretan mucho más que lo que emiten por radiación de Hawking. Les basta, simplemente, acretar la radiación del fondo cósmico, que es universal, para que, en vez de disminuir su masa, la misma crezca. O sea, en un futuro muy lejano, cuando la radiación de fondo cósmico haya caído a una temperatura que esté por debajo de la temperatura de la superficie del agujero negro entonces ahí recién se van a empezar a evaporar. Entonces, no ha sido jamás corroborada experimentalmente la existencia de la radiación de Hawking. De hecho, hay gente que, hoy en día, considera que hasta los agujeros negros no existen o, al menos, no tienen un horizonte de eventos, como lo consideró Hawking.Si eso fuese así, entonces la radicación de Hawking no existe. Es un tema de discusión. En su momento y aún hoy, la importancia de esta aporte reside en el hecho que fue la primera vez que se aplicó la teoría de campos a un espaciotiempo suficientemente curvo como para predecir un efecto semi clásico.

Hasta mediados de los años setenta Hawking hizo aportes importantes pero a partir de los años ochenta, cuando ganó la cátedra Lucasiana de Cambridge ocupada por Newton 350 años antes, empieza a alejarse de la investigación científica y se transforma en una especie de profeta, gurú y figura mediática permanentemente presente en reportajes, entrevistas y programas televisivos. Para un científico, el estar en la consideración popular a través de los medios no está mal y Hawking es un científico muy conocido, probablemente el científico más conocido del mundo. Su fama tiene un nivel de fama comparable al que tuvo Einstein en su momento. Sin embargo, Einstein siempre utilizó su fama para tratar de propagar la razón o de ilustrar al público divulgando ciencia, para tratar de mediar en cuestiones con valor social, siempre a favor de la paz, siempre hizo declaraciones sensatas. Einstein siempre estuvo en contra de que se difundieran pseudo-descubrimientos sensacionalistas. Einstein se llegó a pelear con Schrödinger cuando éste publicó que había hallado una versión de la teoría unificada de campos, que unificaba la gravedad con la electrodinámica, lo cual era algo totalmente prematuro. Einstein reaccionó severamente contra Schrödinger. Einstein era un científico que usósu fama para mejorar la cultura de su entorno. Hawking hace exactamente lo opuesto: por eso yo lo critico. Hawking adopta la posición de un gurú, difunde frases rimbombantes que generalmente incluyen a Dios para llamar la atención: “quiero leer la mente de Dios”. Siempre se ubica a sí mismo en el centro de lo que divulga. Hace predicciones o profecías de cualquier naturaleza. Para el mundial de fútbol 2014 presentó en los medios una ecuación con la cual “yo predigo que Inglaterra va a ganar el mundial de fútbol”. Anunció el fin del mundo para dentro de diez mil años o para cuando se conecte el LHC. En suma, todas cosas que no tienen el menor asidero científico, que son sensacionalistas, que buscan el efecto de aparecer en el titular de los diarios. Hawking es una empresa que vende libros de divulgación. Su libro, Breve historia del tiempo, es pésimo y tiene diez millones de ejemplares vendidos: un gran negocio.

Se dice que es el libro más vendido y el menos entendido…

Es que es increíblemente malo porque no hace lo que tiene que hacer un libro de divulgación que es presentar una visión clara y objetiva del tema que está divulgando. En este caso, el tema es la naturaleza del tiempo y la cosmología pero no dice nada de esas cosas; sólo una serie de divagues y comentarios de sus propios trabajos, muchos de ellos extraordinariamente especulativos pero presentados como física indiscutible. Uno de los mas grandes defectos de un divulgador es cuando presenta lo extraordinario, lo marginal como si fuese lo central. Hawking hace eso permanentemente. Entonces confunde enormemente al público y crea una imagen del científico como una persona que se expresa con frases enigmáticas, con sentencias inapelables que nadie le entiende. Yo creo que esto va en detrimento de la cultura y de la imagen de la ciencia. Hawking le hace el juego a los grandes enemigos de la ciencia, a los irracionalistas y a los posmodernos; sobretodo cuando, por ejemplo, sale a decir que la filosofía ha muerto, que la filosofía no sirve para nada y después hace declaraciones filosóficas presentándose como positivista. O por ejemplo dice que la interpretación de Hugh Everett, de los universos paralelos en mecánica cuántica, es auto evidente. Disparates enormes. Entonces hay muchos filósofos que se nutren para sus trabajos exclusivamente de libros de divulgación y el que más usan es el libro de Hawking. Hay libros de divulgación muy buenos en cosmología, sobre problemas del espacio, del tiempo, pero la gente termina leyendo a Hawking, no puede entender nada y termina con una idea completamente distorsionada.

Hawking, yo creo, está haciendo un servicio muy flaco a la ciencia; de hecho yo creo que la está perjudicando. En 1982, por ejemplo, anunció el fin de la física teórica para fines de siglo XX en un marco de declaraciones ridículas que después nunca se cumplen, porque las hace sin fundamentos. Yo creo que la imagen que tiene que dar un científico es que nunca habla sin fundamento; es la esencia de la ciencia. O sea, basarse en la evidencia y en la razón y no simplemente en la especulación salvaje. Lo que hace Hawking es especulación salvaje. Hay otra gente que hace lo mismo pero no es tan conocida. Por ejemplo, Michio Kaku tiene ribetes payasescos y, pese a estar muy presente en televisión, no tiene la fama de Hawking. Yo los critico a los dos pero voy a criticar más a Hawking porque hay más gente que lo idolatra. Hawking debe su fama, en buena medida, a su discapacidad y no tanto a sus contribuciones empíricas porque hay otros que han hecho mejores contribuciones, no los conoce nadie y también han escrito libros de divulgación. Hawking es figura, en parte, por su situación física: se lo reconoce fácilmente. Él indudablemente usa su situación física para promoverse. Ahora, yo creo que los juicios científicos que emite una persona no deben ser evaluados en función de su estado físico, sino en base a lo que dice. Si dice una estupidez, dice una estupidez independientemente de que tenga una enfermedad neurodegenerativa o no. Todos tenemos enfermedades: yo tengo hernias por todos lados pero no por eso voy a anteponer “no, si me criticás me duele la hernia”. No tiene nada que ver. Mezclan las cosas, pero mi punto era que, para mucha gente, Hawking es intocable y su palabra no se puede revisar jamás. Esa es la imagen que él pretende transmitir y esa es la imagen que, yo creo, hay que combatir porque es lo opuesto a lo que significa la ciencia.

¿Qué científicos divulgadores te merecen respeto?

Hay muchos. Hay muchos en las distintas áreas. Por ejemplo, en neurociencias hay divulgadores excelentes: Michael Gazzaniga, António Damásio, David Eagleman, Ernst Pöppel, Benjamin Libet. En física, Smolin es excelente. Martin Rees ha escrito libros muy buenos. Julian Barbour tiene cosas muy buenas sobre gravedad cuántica e historia. Kip Thorne escribió Tiempo curvo y agujeros negros, que es excelente. Hay clásicos tales como Martin Gardner o George Gamow y, en general, todos los grandes físicos padres de la mecánica cuántica han publicado notables trabajos de divulgación. Russell es siempre un placer que uno se puede deparar.

El problema de algunos nuevos científicos divulgadores, como Brian Greene o Lisa Randall, es el de meterse con cosas extremadamente especulativas. El problema es que escriben grandes libros de divulgación sobre cosas increíblemente especulativas para un público que, por ahí, ignora las cosas más básicas de la física. Por eso yo creo que cualquier libro de divulgación tiene que empezar llevando gentilmente al lector desde el tipo de conocimiento escolar que él ya tiene, que es un conocimiento de una física a duras penas newtoniano, hasta los conceptos mas avanzados que tengan apoyo de cierta evidencia. No deberían centrase en el área en la cual el autor es especialista y, sobre todo, cuando es extraordinariamente especulativa. De lo contrario, más que un libro de divulgación científica es un libro de propaganda de ellos mismos…

Estuve leyendo algunos trabajos tuyos referidos a ciertos objetos autoexistentes del universo, en conexión con el llamado argumento cosmológico de Kalam, que vos enmarcas en una suerte de diálogo ciencia-religión, ¿podés ampliar?

Si, eso fue una conferencia organizada por el Vaticano de diálogo entre ciencia y religión donde se discutían supuestas nuevas versiones de los argumentos clásicos sobre la existencia de Dios. Y había tanto religiosos como científicos. Pero después yo seguí trabajando en eso y comencé a publicar también en revistas de filosofía de la religión. Me interesa mucho a mí el tema de la religión. El tema del argumento deKalam, es que ese argumento es una versión peculiar del argumento cosmológico que fue desarrollado por Algazeli, un filósofo y teólogo musulmán del siglo XI, basándose en el argumento cosmológico de Aristóteles. Esa versión fue resucitada en el año 1979 por un teólogo norteamericano llamado William Lane Craig, en su libro The Kalām Cosmological Argument. Craig utilizaba supuestamente evidencia científica para apoyar la primera y la segunda premisa del argumento. El argumento es muy sencillo, dice: “todo lo que comienza a existir tiene una causa de su existencia”, “el universo comenzó a existir, por lo tanto tiene una causa de su existencia”. Entonces lo que sostiene Craig es que la primera premisa, “todo lo que comienza a existir tiene una causa de su existencia”, es autoevidente y que la segunda premisa, “el universo comenzó a existir…”, está científicamente apoyada por los teoremas de singularidad de Hawking y Penrose. Yo tengo artículos que discuten la validez de ambas premisas y considero que ambas premisas son falsas. No es cierto que, en principio, todo lo que comienza a existir tiene una causa de su existencia, un contra ejemplo es ese que vos mencionabas: en espacios tiempos donde hay curvas temporales cerradas uno puede tener objetos que existen en una región limitada de espacio tiempo pero sobre un bucle cerrado, de tal manera que no hay un comienzo y no hay un final para esos objetos. En cuanto a la otra premisa, el teorema de singularidad de Hawking y Penrose no afirma que el universo comenzó aexistir, sino que si se cumple un conjunto de condiciones entonces el modelo de espaciotiempo que se utiliza para describir el universo, el de Friedmann-Lemaître-Robertson-Walker, es singular. Ahí hay varias cuestiones. Primero, si se cumplen esas premisas y segundo, si el modelo de Friedmann-Lemaître-Robertson-Walkeres el adecuado para describir el universo donde nosotros vivimos y, finalmente, qué es lo que significa que sea singular. Significa que tiene comienzo o no. Entonces, yo creo que, primero, no se cumplen las premisas, hoy sabemos o creemos que el universo se expande aceleradamente, esto quiere decir que probablemente tenga una densidad de energía negativa y una de las premisas del teorema de Hawking y Penrose es que la densidad de energía tiene que ser definida positiva, ya ahí no se aplicaría. Después, es dudoso que la métrica de Friedmann-Lemaître-Robertson-Walker se aplique en el universo porque es una métrica homogénea e isotrópica. Y hay razones para pensar que el universo se aparta al menos de la inhomogeneidad. Nosotros observamos estructuras en el universo, a grandes distancias, que no pueden ser completamente suavizadas con un cambio de escala. Entonces hay razones para pensar que quizás las métricas que deben describir espaciotiempo real sean inhomogéneas. Y finalmente está el tema de la singularidad, la singularidad no es una cosa. No es que los teoremas de Hawking y Penrose predigan la existencia de una singularidad, lo que hacen esos teoremas es mostrar que el modelo de espaciotiempo es singular y decir que singular significa decir que es incompleto. Quiere decir que una geodésica no puede ser extendida más allá de un cierto punto. No son teoremas de existencia, como los teoremas de existencia de una solución, de una ecuación, sino que son teoremas de incompletitud. Muestran que la teoría que usamos, la de la relatividad general, es incompleta en el sentido que no describe todo el dominio de la realidad. La teoría no permite hacer ningunaafirmación sobre la región singular, para eso necesitas una teoría diferente. No quiere decir que necesariamente haya habido un origen del universo en esa región, porque no hay una teoría para describir o proponer que ahí se quebraron todas las leyes de conservación. Probablemente, la teoría que describa correctamente eso, una teoría cuántica de la gravedad, implique que la gravedad a esas escalas es altamente repulsiva, entonces es mucho más sensato pensar en lo que se llama un rebote de un estado previo de contracción que en una generación espontánea que viola todas las leyes conocidas de la física. Eso te muestra como cuando un teólogo o un filósofo a veces usa un argumento filosófico y trata de invocar cuestiones científicas en su apoyo cometen errores garrafales por no entender realmente de qué están hablando. En el caso de WilliamLane Craig, yo creo que él entiende, pero es un propagandista. Él ya tiene una posición a priori y entonces lo que trata es de defenderla con todos los medios que tiene. Pero, en general, la gente comete muchas equivocaciones cuando habla de singularidades. Los temas de singularidades, insisto, son temas de incompletitud. No son teoremas de existencia. Las singularidades no son cosas. Una teoría singular quiere decir que tiene un ámbito en el cual no funciona. Porque si vos haces las cuentas te da infinito. Pero no quiere decir que existe un infinito ahí, sino que la teoría no sirve.

Del lado religioso, ¿cuál es la real postura? Antes del Big Bang, ¿la religión? y después del Big Bang, ¿la ciencia?

Bueno, yo creo que muchos religiosos siguen aferrados a la idea de que el universo fue creado en la región que la teoría de la relatividad no explica, esa región de incompletitud. Pero no hay ningún argumento para pensar que eso sea así, y menos en ausencia de una teoría que, de momento, nos diga cómo se comporta la física en ese nivel de energía. Mi opinión personal es que hay muchas razones para pensar que a ese nivel la gravitación es la fuerza dominante. No solo eso, sino que debió ser repulsiva. Lo mismo pasa en el interior de los agujeros negros. El agujero negro es el resultado del colapso de una estrella entonces, una vez que se forma el horizonte de eventos –que no es una puerta a otro universo– la materia que colapsó sigue estando ahí adentro, si no desde afuera no se percibiría la atracción gravitacional, pero ¿dónde está? Está concentrada en una región muy pequeña en el centro del sistema. O sea hay alguna fuerza que la está aguantando. Yo lo que pienso es que la fuerza que la está aguantando es una densidad de energía negativa que genera el campo gravitacional cuando está en régimen cuántico. Son los únicos objetos que pueden existir en forma estable con la gravedad manifestándose cuánticamente. El problema es que cómo estudiarlo en forma directa considerando que está del otro lado del horizonte de eventos. Hay que buscar formas indirectas de tratar de llegar ahí.

En general, en el ámbito religioso se trata de seguir tratando de invocar a la ciencia para apoyar ideas creacionistas, en mi opinión, sin demasiado éxito. Ahora, hay muchos científicos que también se prestan a eso como para quedarse con la conciencia tranquila. Hay mucha gente que era religiosa antes de ponerse a estudiar física o ciencia y que mantuvo su religión, por una cuestión de costumbre, pero inevitablemente se le genera cierta tensión entre su profesión diaria, los estándares de rigurosidad, de racionalidad, de las evidencias que exige a la hora de tratar un tema científico y lo que hace en su vida privada. Entonces, esa gente se consuela, como vos dijiste, diciendo que puede mandar a Dios al Big Bang, dado que ahí no se entiende bien qué pasa y “bueno, pongámosolo en ese lugar”. Yo creo que eso es una actitud intelectualmente deshonesta y que hay muchas razones para pensar que la mera idea de Dios es contradictoria, por lo menos en cómo la formulan los teólogos y cómo la formulan los filósofos de la religión en general, y no hace falta ni siquiera preocuparse por el Big Bang para descartarlo.

La presunta naturaleza de la conciencia como manifestación macroscópica de procesos cuánticos en la química del cerebro, propuesta por Roger Penrose, a priori tiene cierto atractivo estético pero ¿qué hay de la fundamentación científica?

El problema es el siguiente, las neurociencias han progresado muchísimo. Sabemos muchísimo ahora del cerebro, mucho más que hace veinte años. Hay una enorme cantidad de experimentos que combinan técnicas de mapeo de cerebro vivo con experimentos psicológicos diseñados con mucho cuidado, con análisis del contenido de los neurotransmisores en cerebro vivo. Existe toda una batería de experimentos que nos han mostrado un montón de cosas acerca del cerebro, de cómo funciona, de cómo se producen los pensamientos, de cómo se produce la conciencia y demás. Todos los fenómenos que ocurren en el cerebro son fenómenos clásicos, no hay fenómenos cuánticos. Eso no quiere decir que no haya fenómenos cuánticos a escala macroscópica. Por ejemplo, un superconductor es un sistema cuántico macroscópico al igual que una estrella de neutrones que tiene la densidad de un núcleo atómico y es un sistema cuántico. No es el caso del cerebro, que es un sistema biológico y los procesos que ocurren en el cerebro son todos procesos bioquímicos. No hay procesos cuánticos que tengan incidencia en el funcionamiento del cerebro. Todas la peculiaridades de la física cuántica son borradas en el caso del cerebro que funciona, básicamente a través de impulsos eléctricos o cambios de diferencia de potencial que producen liberación de un montón de partículas, los neurotransmisores, que activan o inhiben las neuronas. Entonces, eso no tiene nada que ver con lo cuántico. De hecho, estaba la idea vieja de que el cerebro es como un sistema donde hay cables que transmiten corriente eléctrica, y eso también es falso. Básicamente, los portadores de actividad en el cerebro son los neurotransmisores, que son pequeñas partículas, moléculas, que entran en la sinapsis modificando su conductivad; es decir, aceleran o desaceleran el ritmo de disparo de las sinapsis y, por lo tanto, de la neurona. Cumplen funciones de inhibición o de excitación de acuerdo al neurotransmisor de que se trate o al estímulo externo. Pero la mecánica cuántica no juega ningún rol en eso.

¿Cómo un científico prestigioso como Roger Penrose puede arriesgar esta hipótesis tan osada?

Penrose es un brillante matemático, es un científico muy superior a Hawking, de lejos. Ha hecho realmente aportes increíbles pero todas estas ideas acerca de la conciencia las ha hecho en libros de divulgación, no en revistas con referato. Habría que entender mejor la psicología de Penrose a ver por qué se dedica a eso.

Max Tegmark, un cosmólogo joven de trascendencia considerable, fue un férreo opositor a la propuesta de Penrose sobre la conciencia pero, en la actualidad, aparecen algunas noticias sobre trabajos suyos que la avalarían.

Tegmark es un tipo de mi edad y yo publicaba el mismo tipo de cosas en la misma época. Lo conozco de la época en que él hacía ciencia solamente; ahora además, se hizo una figura mediática. Empezó haciendo trabajos muy buenos sobre radiación de fondo cósmico, algunas cuestiones de astrofísica, de cosmología y otras. Si, cuando estaba en esa etapa puramente académica era muy crítico de estas ideas de Penrose. Y también era crítico de otra idea de Penrose que es que el campo gravitacional puede hacer colapsar la función de onda. Pero después empezó a escribir libros de divulgación, empezó a ser consultor de distintos programas, empezó a tener también un auge de popularidad y yo veo que, muchas veces, a muchos autores que llegan a ese estado de científico-divulgador, sufren un cambio de fase y, lo que antes les resultaba inhibitorio –hacer anuncios o hacer afirmaciones sin evidencia suficiente–, la pierden y lo pasan a hacer con facilidad. Es un tema de realimentación positiva porque cuanto más exagerada sea la afirmación arriesgada, más repercusión mediática tiene y, por lo tanto, más libros venden, más son las invitaciones a dar conferencias, más entrevistas en los medios. Hay mucha gente que entra en ese circuito. Yo no conozco exactamente lo que ahora le ha pasado a Tegmark, pero es un tipo que ha trabajado muy seriamente y de repente está haciendo un montón de declaraciones que sorprenden por su liviandad, ¿no? Quizás sea una manifestación más de ese fenómeno cultural de crisis que hablábamos al principio. Yo ya diría que no es una crisis solamente de la física teórica, es una crisis un poco de la cultura occidental. De los valores de la cultura occidental, de que es lo que consideramos valioso. Evidentemente ya no es importante para nosotros la verdad o el conocimiento, parecería que la fama, la idea que los otros tienen de nosotros mismos, el dinero y el estatus ocupan un lugar importante ya no solo en la vida cotidiana sino, también, dentro de las actividades culturales. Lo cual es muy triste. Ese tipo de sistema, por ejemplo, ha destruido en buena medida el cine, hoy por hoy vos vas al cine y ya sabes cual es el final de la película. Hay todo un recetario que es el que está probado, que es el que mas vende y te tenés que ajustar a eso, entonces todo lo que tiende a ser masivo tiende a tener ese patrón. Si querés ver una película original vas a tener que ir a ver una película que se tuvo que hacer con doscientos mil dólares, no con cien millones. Eso es un grave problema, un grave problema cultural.

Lee Smolin habla de alternativas a la teoría de cuerdas que no logran prevalecer por esas causas sociológicas que vos describías anteriormente, ¿qué opinás?

Smolin hace un análisis muy sobrio de todo este problema en su libro “The Trouble with Physics”. Un muy buen libro que apareció en el año 2006. Él discute un poco la sociología que hay detrás de todo esto y enfatiza que no se debe confundir las aspiraciones de la teoría de cuerdas. La teoría de cuerdas no aspira a ser una teoría cuántica de la gravedad sino una teoría del todo. El problema fundamental de la física actual no es tener una teoría de todo, a priori ni siquiera es necesario que exista una teoría del todo. Podría ser formulable o no, no lo sabemos. Pero hay problemas concretos que sí deben ser atendidos y uno de ellos es que tenemos una teoría de campo clásica para describir la gravedad y descripciones cuánticas para el resto de los campos de la naturaleza. Sin embargo hay razones para pensar que la gravedad también debe comportarse en forma cuántica, por lo menos en ciertas circunstancias. Pero no sabemos como cuantificar la gravedad. Ahora, hay diversas formas de encarar ese problema, una es como lo hace Rovelli, a través de una teoría que se llama Quantum Loop Gravity que trata de cuantificar los volúmenes de espacio. Otras aproximaciones tienen que ver con la postulación de una ontología no ya de cosas que tienen propiedades que cambian sino de eventos básicos que después se pueden asociar para formar lo que nosotros, a gran escala, percibimos como cosas. Eso es lo que se llama Causal Set theory y su principal impulsor es Rafael Sorkin. Después está la aproximación de Ashtekar que es lo que se llama Canonical Quantum Gravity, que es la forma más tradicional de atacar el problema. Hay muchas formas de atacar el problema de la gravedad cuántica, yo creo que a la larga se va a terminar resolviendo. Es un problema muy difícil porque hay una diferencia fundamental entre la gravedad y las otras fuerzas, entre la teoría de la gravitación y las teorías de las otras fuerzas: para todas las otras fuerzas los campos que describen las interacciones existen en un espaciotiempo que está dado o impuesto desde afuera. Mientras que en la teoría general de la relatividad el campo está identificado con la métrica del espaciotiempo. En la teoría de la relatividad el espaciotiempo es parte de la propia teoría mientras que en las otras teorías el espaciotiempo es como un escenario inerte y la cuantificación del campo es sobre ese espaciotiempo. En relatividad general el espaciotiempo está representado en forma continua; la variedad que representa el espaciotiempo es una variedad continua, o sea, son números reales y los números reales son densos: siempre hay infinitos números reales pero si el espaciotiempo debe ser discreto ¿en qué momento eso deja de valer?. La llamada hipótesis del continuo, que introdujo Cantor en el siglo XIX, se tendría que quebrar: cómo, cuándo, no lo sabemos pero, digamos, hay idea de como atacar el problema. Ahora, en la medida que el grueso de los recursos se dediquen a no a resolver este problema real y concreto que lo podemos formular claramente y se dediquen a hacer una teoría del todo, no se está tratando de responder ninguna pregunta concreta, sino simplemente que está tratando de proponer una imagen del universo que no es cerrada porque ni siquiera puede llegar a dar los valores de los parámetros libres del modelo estándar de las partículas elementales. Así no iremos a ningún lado. El modelo estándar es un modelo que tiene una fuerte componente fenomenológica: hay un montón de constantes que aparecen en ese modelo que se determinan por el experimento. No salen de la teoría. Lo idóneo en una teoría es que pueda fijar el valor de esos parámetros libres desde su interior. La teoría unificada, esta que propone ser la de cuerdas, no permite fijar ninguno de esos valores.

Witten dice que la teoría de cuerdas predice la supersimetría.

No, eso es otro error. No es cierto que la teoría de cuerdas prediga la supersimetría. Lo que sucede es que la teoría de cuerdas sólo puede ser válida si es válida la supersimetría. La supersimetría fue postulada antes de que existiese la teoría de cuerdas. La supersimetría es una simetría, que no sabemos si existe o no en la naturaleza, entre las partículas del tipo bosones y las del tipo fermiones . Para cada un de esas familias hay una partícula supersimétrica que existiría supuestamente de tal manera que eso define un grupo de simetría mucho mas grande que el que usa el modelo estándar. Ahora, la teoría de cuerdas solo se puede desarrollar en forma coherente, internamente, si vale la supersimetría pero no se sabe si existe o no la supersimetría. Todos los intentos de detectar partículas supersimétricas en el Large Hadron Collider han fallado. Entonces ¿qué dicen los teóricos?, dicen: “bueno, la supersimetría se manifiesta en energías más altas”, obvio, como la escala de energía no está fija en la teoría puede estar en cualquier lado. La energía a la que llega el Large Hadron Collider en este momento es de 14TeV y el tope sería la energía de Planck de 1019 GeV. Un enorme rango de magnitudes que jamás se van a lograr alcanzar en un acelerador de partículas. En la práctica, siempre van a decir: “bueno, no, la supersimetría por ahí se manifiesta en energías más altas”. Entonces, en ese sentido, si bien la teoría podría ser refutable si se probara que no existe la supersimetría; en la práctica, nunca se va a poder probar que no existe la supersimetría porque nunca vas a llegar a las energía de Planck en un acelerador de partículas. Ahora bien, no se puede demostrar que la supersimetría no existe, lo que si se podría demostrar es que existe la supersimetría porque puede ser que se encuentre una partícula supersimétrica. Si se demuestra que existe una partícula supersimétrica, no quiere decir que la teoría de cuerdas sea verdadera, simplemente dice que vos podes formular, en forma matemáticamente consistente , una teoría de cuerdas que todavía sigue sin predecir nada. No es que la teoría de cuerdas predice la supersimetría. Ahí hay un juego de palabras de Witten que no es fiel a la realidad. Los cuerdistas siempre tratan de vender lo mejor posible lo que están haciendo.

La conjetura de Maldacena, que entiendo fue un avance espectacular en el formalismo de la teoría de cuerdas, corresponde a un espaciotiempo de Anti-De Sitter que no es el que observamos en nuestro universo actual. Maldacena admite que el espaciotiempo observable esconde soluciones muy inestables de las teorías de cuerdas pero que confía que, en algún momento, podrán resolverse, ¿vos ves que por ahí va a haber alguna salida o no?

Lo que descubrió Maldacena fue un truco para hacer cuentas en teoría de cuerdas. Se dio cuenta que es mucho más fácil hacer las cuentas en ese espacio Anti-De Sitter que hacerlos en el espacio real. Son cuentas de la teoría de cuerdas. O sea, básicamente es un método de cálculo. El universo real no es Anti-De Sitter, por el contrario probablemente sea De Sitter porque, si es cierto que se está expandiendo en forma acelerada como parecen indicar algunas observaciones, entonces la geometría actual del universo es una geometría que corresponde básicamente a un universo De Sitter. De Sitter implica un universo que es descripto por las ecuaciones de Einstein con un término de constante cosmológica positiva. Lo de Maldacena no se aplicaría al universo real por todo lo que sabemos. Lo que si tiene de positivo el método de cálculo de Maldacena es que en algunas áreas de materia condensada se está aplicando exitosamente. Entonces, ¿qué está pasando?, los cuerdistas intelectualmente más honestos se están pasando a materia condensada aplicando esa potente herramienta de cálculo , lo cual a mi me parece muy bueno. El problema es que hay otros cuerdistas que son irreductibles, por decirlo de alguna manera, y que siguen empeñados en trabajar con geometrías que no se corresponden al mundo real, sin hacer ningún tipo de predicciones y, en el fondo, lo que están haciendo es matemática pura. Por eso a Witten le dieron la Fields Medal de matemática. Nunca descubrió absolutamente nada. Esa es la realidad.

Otra cosa de la que se queja Rovelli, no se si vos coincidís, es que hay una tendencia a “vamos a calcular esto como si valiera la hipótesis de…”, donde no hay prejuicio de que esa hipótesis sea antinaturalmente arbitraria.

Claro, exactamente. Así empiezan todos: “Consideramos el siguiente lagrangiano…”, entonces definen un lagrangiano con términos de autointeracción, campo de taquiones y de ahí hacen las cuentas, salen las soluciones y llegan a un universo que está dominado por taquiones puede expandirse en forma acelerada si pasa…” Ahora, ¿existen los taquiones?, no, no existen; ¿el campo de taquiones es estable? no, es inestable ya que las autoperturbaciones del campo de taquiones los desestabiliza; entonces, ¿cuál es el sentido de todo eso?, ninguno. Es matemática, es “postulo este lagrangiano, resuelvo las ecuaciones de movimiento y veo como se mueve el sistema”. Ahora, ¿el lagrangiano describía un sistema físico?, no. Es más, el sistema hipotético que describe ese lagrangiano ¿es estable?, muchas veces la respuesta hasta es no. O sea, ni siquiera tiene chances de existir, no es que no existe sino que no puede existir, que es mucho peor. Y eso es una industria que se ve mucho en física.

Algunos físicos, no necesariamente defensores de la teoría de cuerdas, opinan que, por ejemplo, alternativas como la Quantum Loop Gravity tienen el mismo grado o más de no falsabilidad y descontextualización que las cuerdas.

Si, no se si tanto más, pero por lo menos es refutable. Personalmente yo no creo que el abordaje de la Quantum Loop Gravity lleve a algo interesante porque hay problemas muy de fondo respecto a qué es el espaciotiempo mismo que están en las bases de esa teoría. Ahí lo que hacen es cuantificar elementos de volumen, pero esos elementos de volúmenes ¿qué son?. Yo pienso que hay que partir de mucho más atrás. Yo creo que el problema solo se va a resolver cuando podamos construir el espaciotiempo como una entidad emergente de algo más básico. Y, en mi opinión, el mejor candidato que tenemos para algo más básico es lo que se llaman eventos aislados. O sea, hemos siempre pensado como Demócrito en forma atomista, como que los constituyentes últimos de la realidad son partículas materiales; esto es, un sistema físico con propiedades que pueden cambiar. Ahora, a esos cambios de las propiedades del sistema físico los llamamos eventos pero esa concepción atomista tiene muchos problemas porque tiene que haber una longitud mínima que debería coincidir con la escala de Planck. Pero si hay una longitud mínima sería incompatible con la relatividad, porque la longitud puede modificarse simplemente cambiando el sistema de referencia; entonces, si era mínima se puede pasar a un sistema de referencia donde sea más chica y, entonces, no sería mínima. Entonces, todas esas teorías terminan violando lo que se llama la invariancia de Lorentz. La forma de no violar la invariancia de Lorentz es postular cosas que no tengan dimensión ni estén en el espacio ni en el tiempo. Y esos serían estos eventos o lo que, con otra nomenclatura, Leibniz llamaba las mónadas: elementos existenciales básicos que no tienen dimensión ni tienen duración. Las categorías de espaciotiempo ya no se aplican a ellos; el espaciotiempo emerge cuando hay muchos de estos eventos luego de lo cual recién ahí aparece la métrica. El desafío, yo creo, está en tratar de construir la métrica que es con un campo emergente en el límite de los grandes números de una teoría en la cual los componentes más básicos no sean espaciotemporales. Causal Set Theory va en esa dirección, pero hay enormes problemas para lograrlo. Son temas muy difíciles, son temas que es natural que lleven mucho tiempo resolverlos porque son realmente complejos. Sin duda no se van a resolver si no se les dedica tiempo y, en la medida que la gente esté pensando en cuestiones que sabe a priori que son callejones sin salida y simplemente sigue en eso porque fue educado en esas herramientas de cálculo y es lo único que sabe hacer, no lo vamos a resolver.